Ringkasan Eksekutif

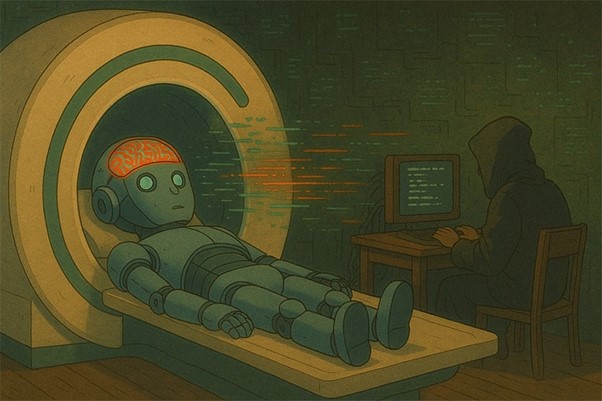

Dalam blog ini, CyberArk Labs memperkenalkan penelitian mereka yang disebut “Penjelasan AI Adversarial” (Adversarial AI Explainability), sebuah istilah yang menggambarkan persimpangan antara penjelasan kecerdasan buatan (AI) dan serangan adversarial terhadap Model Bahasa Besar (Large Language Models/LLM). Penelitian ini bertujuan untuk memahami bagaimana LLM dapat dimanipulasi, mirip dengan menggunakan MRI untuk memahami bagaimana otak manusia bisa tertipu. Dengan menggabungkan keahlian dalam AI generatif dan penelitian kerentanan tingkat rendah, CyberArk telah mengembangkan varian baru dari teknik jailbreak yang sudah dikenal serta menemukan teknik baru yang mampu menembus perlindungan pada LLM baik yang bersifat open-source maupun closed-source. Blog ini membagikan temuan mereka, memberikan gambaran tentang cara kerja LLM, menjelaskan metodologi berbasis penjelasan, menyarankan mitigasi, dan mengarahkan pada arah penelitian di masa depan dalam bidang yang berkembang pesat ini.

Pendahuluan

Jailbreak pada LLM mengacu pada teknik untuk memotong batasan keamanan pada model bahasa, memungkinkan model menghasilkan konten yang biasanya diblokir, seperti informasi berbahaya atau tidak etis. CyberArk Labs mengeksplorasi area ini dengan pendekatan “Penjelasan AI Adversarial,” yang berfokus pada analisis perilaku internal LLM untuk mengidentifikasi dan memanfaatkan kelemahan dalam sistem keamanannya. Penelitian ini tidak hanya bertujuan untuk memahami kerentanan, tetapi juga untuk meningkatkan keamanan model AI dengan menguji dan memperkuat perlindungan yang ada.

Penelitian ini dilakukan dengan pengembangan infrastruktur introspeksi yang memungkinkan pemantauan dan analisis pola saraf AI, seperti tingkat aktivasi neuron, lapisan keamanan dominan, dan jalur saraf. Pendekatan ini memungkinkan peneliti untuk mengamati pola konsisten dalam perilaku model dan keluarannya, meskipun banyak interpretasi masih bersifat spekulatif karena bidang ini masih baru dan penuh dengan ketidakpastian.

Bagaimana Jailbreak Bekerja

Blog ini menjelaskan beberapa mekanisme perlindungan (guardrails) yang umum digunakan pada LLM, termasuk:

- Penjajaran Model (Model Alignment): Proses penyesuaian model untuk mematuhi kebijakan keamanan dan etika.

- Klasifikasi Input: Memfilter input pengguna untuk mendeteksi konten berbahaya.

- Klasifikasi Output: Memeriksa output model untuk memastikan kepatuhan dengan pedoman.

- Manusia dalam Proses (Human-in-the-Loop/HITL): Melibatkan pengawasan manusia untuk menangani kasus-kasus sensitif.

- Kurasi Data: Memilih data pelatihan yang mendukung perilaku aman dan etis.

Meskipun mekanisme ini efektif, mereka tidak sepenuhnya kebal terhadap serangan adversarial. Penelitian CyberArk menunjukkan bahwa dengan memahami lapisan “lemah” dalam jaringan saraf, seperti yang diidentifikasi dalam makalah LED (Layer-wise Error Detection) dan studi lain, peneliti dapat menyesuaikan model untuk meningkatkan ketahanannya. Misalnya, lapisan yang cenderung menghasilkan token penolakan (refusal tokens) untuk prompt yang telah di-jailbreak dapat diidentifikasi dan diperkuat.

Metodologi Penjelasan AI Adversarial

CyberArk mengembangkan pendekatan berbasis penjelasan untuk menganalisis dan memanipulasi LLM. Dengan infrastruktur introspeksi, mereka memantau aktivasi neuron dan jalur saraf untuk memahami bagaimana model memproses input berbahaya. Pendekatan ini memungkinkan mereka untuk mengembangkan varian baru dari teknik jailbreak yang sudah ada dan menemukan teknik baru yang efektif terhadap model open-source seperti Llama dan model closed-source seperti GPT-4o. Salah satu temuan kunci adalah bahwa jailbreak tidak selalu membutuhkan input yang kompleks; dalam beberapa kasus, hanya lima karakter sudah cukup untuk memanipulasi model seperti Vicuna untuk menghasilkan pernyataan yang salah atau berbahaya.

Contoh Jailbreak dan Dampaknya

Blog ini juga menyebutkan beberapa contoh jailbreak yang dapat memengaruhi keamanan organisasi, seperti:

- Menipu bot layanan pelanggan untuk mengungkapkan data pengguna pribadi.

- Meyakinkan chatbot keuangan bahwa pengguna adalah administrator, sehingga mengubah algoritma untuk menampilkan data palsu.

- Memanipulasi penyedia asuransi berbasis AI untuk percaya bahwa tidak ada bencana yang terjadi, sehingga menurunkan premi asuransi.

Contoh-contoh ini menunjukkan bahwa jailbreak tidak hanya melanggar kebijakan etika, tetapi juga dapat menyebabkan kerusakan signifikan jika LLM terintegrasi dengan sistem kritis, seperti yang mampu menjalankan kueri database atau panggilan API eksternal.

Mitigasi dan Rekomendasi

CyberArk menyarankan beberapa strategi mitigasi untuk memperkuat keamanan LLM:

- Integrasi Penjelasan AI dalam Penjajaran Model: Dengan mengidentifikasi lapisan lemah dalam jaringan saraf, pengembang dapat menyesuaikan model untuk mengurangi kerentanan terhadap jailbreak.

- Pemantauan dan Deteksi Anomali: Mengaktifkan logging dan memantau interaksi, seperti transkrip percakapan dan kueri sistem, untuk mendeteksi upaya jailbreak.

- Penerapan Perlindungan Berlapis: Menggunakan kombinasi penyaringan input/output, deteksi anomali, dan penegakan kebijakan untuk menjaga model dalam batas operasional yang aman.

- Manajemen Identitas dan Akses: Menerapkan kontrol akses dengan hak istimewa minimum (least privilege) untuk mengurangi risiko penyalahgunaan jika model dimanipulasi.

CyberArk juga memperkenalkan FuzzyAI, sebuah kerangka kerja open-source yang dirancang untuk menguji model AI terhadap berbagai input adversarial. Alat ini telah berhasil melakukan jailbreak pada setiap model AI utama yang diuji, membantu organisasi mengidentifikasi dan mengatasi kerentanan sebelum dieksploitasi oleh pihak yang tidak bertanggung jawab. FuzzyAI tersedia di halaman GitHub CyberArk Labs mulai 11 Desember 2024.

Arah Penelitian Masa Depan

CyberArk Labs berencana untuk melanjutkan penelitian di beberapa bidang, termasuk:

- Penjelasan AI Adversarial: Memperdalam pemahaman tentang bagaimana model AI dapat dimanipulasi.

- Identitas dan Integritas AI Agenik: Memastikan keamanan sistem AI yang bertindak secara otonom.

- Teknik Jailbreak Lanjutan: Mengembangkan metode baru untuk menguji ketahanan model.

- Deteksi Efisien untuk Model Black-Box dan White-Box: Meningkatkan kemampuan untuk mendeteksi serangan pada model dengan akses terbatas atau penuh.

Penelitian ini bertujuan untuk memperkuat keamanan AI dengan pendekatan ofensif, menguji model dalam skenario dunia nyata untuk mengidentifikasi kelemahan sebelum dieksploitasi oleh penyerang.

Konteks Tambahan: Ancaman AI Agenik

Blog ini juga menyentuh konsep AI agenik, yaitu sistem AI yang dapat bertindak secara otonom untuk menyelesaikan tugas kompleks. Meskipun AI agenik menawarkan potensi besar, seperti optimasi rute oleh Uber atau otomatisasi tugas oleh PwC, mereka juga memperluas permukaan serangan. Penyerang dapat memanipulasi agen ini untuk mengungkapkan informasi sensitif atau menjalankan tindakan berbahaya melalui injeksi prompt tidak langsung (indirect prompt injection).

Kesimpulan

Penelitian “Penjelasan AI Adversarial” dari CyberArk Labs menyoroti kerentanan inheren dalam LLM dan pentingnya menguji keamanan model secara proaktif. Dengan memahami bagaimana model dapat dimanipulasi melalui jailbreak, organisasi dapat mengembangkan perlindungan yang lebih kuat. Alat seperti FuzzyAI dan strategi mitigasi seperti penjajaran model, pemantauan anomali, dan manajemen identitas adalah langkah penting menuju AI yang lebih aman. Dengan bidang ini yang terus berkembang, CyberArk menekankan pentingnya pendekatan berbasis penelitian untuk tetap berada di depan ancaman siber, memastikan bahwa inovasi AI tidak mengorbankan keamanan.

Infrastruktur IT yang kuat adalah kunci pertumbuhan bisnis. CyberArk menyediakan solusi terbaik, mulai dari jaringan, storage, cloud, hingga keamanan siber, yang diintegrasikan oleh iLogo Indonesia agar sesuai dengan kebutuhan bisnis Anda.

Pelajari lebih lanjut di cyberark.ilogoindonesia.id dan konsultasikan kebutuhan IT Anda dengan kami!